Blog

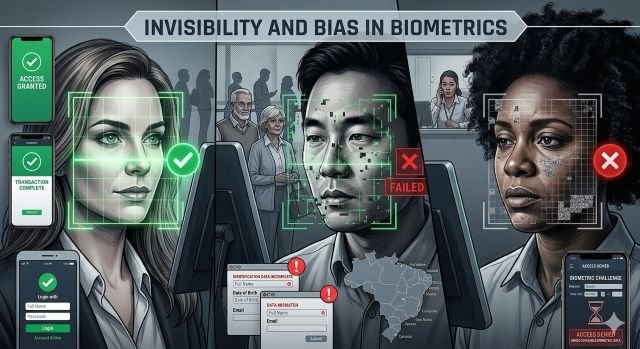

A fricção invisível da biometria: como afrodescendentes, asiáticos e outros grupos enfrentam mais erros – e por que o Brasil ainda ignora o problema

A fricção invisível da biometria: como afrodescendentes, asiáticos e outros grupos enfrentam mais erros — e por que o Brasil ainda ignora o problema

Por Henrique S.G. Costa (link para perfil no LinkedIn) e Robinson Lamas (link para o perfil no LinkedIn)

Introdução

Em um evento de identidade digital, perguntei a uma diretora de um grande marketplace se as soluções de reconhecimento facial impactavam pessoas de etnias afrodescendentes. Após um silêncio constrangedor, a resposta foi: “não vemos problemas”. Foi uma resposta fácil — e possivelmente errada. O problema existe; o que falta é mensuração. A biometria já integra a jornada digital de milhões de brasileiros, mas nem todos são reconhecidos da mesma forma.

A presença da biometria no dia a dia

Bancos digitais, operadoras, aplicativos de transporte, e‑commerces e serviços públicos dependem de reconhecimento facial ou digital para validar identidades. A promessa é segurança e agilidade. Na prática, porém, a tecnologia não funciona igualmente para todos: grupos historicamente sub‑representados — afrodescendentes, asiáticos e outras minorias étnicas, que enfrentam taxas de erro muito maiores, com consequências que vão da frustração à exclusão e à suspeita injusta de fraude.

Números que revelam desigualdade

Estudos internacionais documentam vieses significativos em algoritmos de reconhecimento facial. Testes independentes mostraram discrepâncias marcantes: taxas de falsos positivos muito maiores para pessoas de pele mais escura e para asiáticos;

O relatório do National Institute of Standards and Technology (NIST), um dos mais abrangentes do mundo, analisou 189 algoritmos de reconhecimento facial e encontrou discrepâncias marcantes:

- Taxas de falsos positivos até 100 vezes maiores para afrodescendentes e asiáticos em comparação com pessoas brancas.

- Em alguns algoritmos, mulheres afrodescendentes tiveram erro de identificação acima de 30%

- Sistemas comerciais amplamente utilizados apresentaram erro entre 10% e 35% para rostos de pessoas de pele mais escura

Esses dados não são abstrações: traduzem‑se em contas bloqueadas, cadastros abandonados e processos de verificação intermináveis.

Casos e relatos no Brasil

Embora não existam dados oficiais segmentados por etnia no país, plataformas como o Reclame Aqui acumulam centenas de queixas sobre falhas de reconhecimento facial em bancos digitais, fintechs e operadoras. Padrões se repetem: “o sistema não reconhece meu rosto”, “minha conta foi bloqueada sem motivo”, “tive que tentar várias vezes”, “só consegui resolver com atendimento humano”. Relatos nas redes sociais ilustram o impacto: clientes que precisaram enviar múltiplos vídeos para provar identidade; motoristas de aplicativo suspensos por “uso indevido” quando, na verdade, o sistema não reconheceu seu rosto.

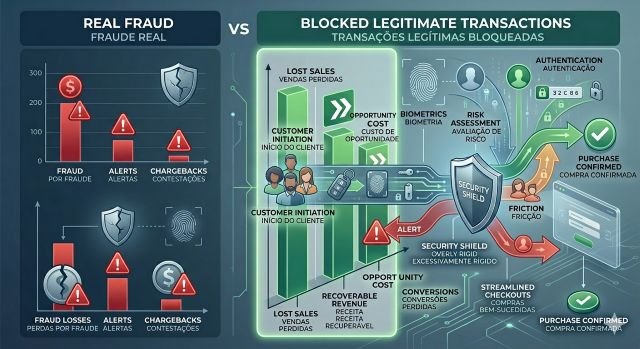

O custo invisível para empresas e clientes

Cada falha gera atrito na jornada do cliente, aumenta o tempo de atendimento e eleva custos operacionais. Empresas relatam que até 20% dos abandonos de cadastro podem estar ligados a problemas de verificação de identidade — perda direta de receita. No setor financeiro, bloqueios indevidos reduzem o uso de aplicativos e afetam engajamento. No campo reputacional, consumidores que enfrentam repetidas falhas compartilham suas experiências negativas, amplificando a percepção de que a empresa “não funciona para mim”.

Por que o Brasil ainda ignora?

Parte do problema é governança tecnológica: nenhuma grande empresa brasileira divulga métricas segmentadas por etnia, gênero ou faixa etária; não há auditorias públicas nem regulamentação que exija esse monitoramento. Sem dados, cada caso vira um incidente isolado em vez de um sintoma de um problema estrutural. Enquanto isso, o impacto permanece invisível para gestores e visível para quem vive a experiência.

A Visão de Negócios

Aqui entra um ponto que pouca gente está conectando: Isso não é só inclusão, é negócio!

Cada falha gera:

- Abandono de cadastro;

- Aumento de custo operacional;

- Queda de conversão;

- Pressão no atendimento;

E o mais perigoso: Perda de confiança.

Porque o cliente não pensa: “o algoritmo falhou”, ele pensa: “essa empresa não funciona pra mim”

Se você trabalha com CX, produto ou tecnologia, vale um teste rápido.

Sua empresa mede:

- Taxa de falha por perfil de cliente?

- Abandono na etapa de validação?

- Quantos clientes caem para atendimento humano?

Se a resposta for “não”… você pode estar perdendo clientes e sem saber por quê.

A biometria foi criada para reconhecer pessoas. Mas hoje, em muitos casos, ela decide quem é reconhecido e quem não é.

Caminhos para uma biometria inclusiva

Para transformar a promessa tecnológica em prática justa, são necessárias medidas concretas:

- Medir desempenho por grupo demográfico.

- Auditar algoritmos regularmente por entidades independentes.

- Exigir diversidade nos conjuntos de treinamento.

- Oferecer alternativas de autenticação igualmente seguras.

- Comunicar com transparência procedimentos e falhas aos usuários.

A tecnologia só é inclusiva quando funciona para todos; oferecer caminhos alternativos evita que grupos específicos sejam penalizados sistematicamente.

Enquanto não se medir o que ocorre, o problema vai continuar sendo invisível para as empresas e extremamente visível para quem vive isso todos os dias.